导语:

9月25日,联想在杭州举办以“全栈智能 全程陪伴”为主题的新IT思享会,集中展示了联想基于新IT架构的全栈智能产品与服务,引领行业智能变革的强大实力。

当前,以ChatGPT为代表的AI模型席卷全球,不仅实现了AI技术质变性突破,还推动AI应用与产业融合,加速AI落地千行百业。

在此背景下,联想中国区基础设施事业部架构师耿太平在会上,重点详细解读了联想AI算力战略,以及具体落地实践。他表示:“在实际业务实践中,联想AI导向的基础设施聚焦大模型训练、训推一体、AI For Science和AI生成四大AI应用场景,提供软硬件整体方案来落地联想AI算力战略。”

(联想中国区基础设施事业部架构师耿太平)

锚定AI算力,聚焦四大场景打造AI导向基础设施

全球人工智能发展汹涌澎湃,算力规模不断攀升。截止2021年,中国的算力规模达到203EFLOPS,仅次于美国位居世界第二,年增长率为53%,高于全球平均的增长率10个百分点。会上,耿太平表示,目前AI算力规模已经超过通用算力,未来预计到2026年,仅中国的AI算力规模就会达到1271.4 EFLOPS,年复合增长率达52.3%,AI算力成为算力发展的主要方向。

面对日益增长的AI算力需求,联想在今年8月,正式发布AI算力战略,全面打造以AI为导向的算力基础设施。耿太平介绍道,联想AI算力战略具备AI赋智和绿色赋能两大特征。其中,AI赋智为,100%算力基础设施产品支持AI,50% 基础设施研发投入在AI领域,全面AI技术覆盖全域AI应用;绿色赋能是指,全面布局和引领液冷技术,打造液冷集群方案灯塔,以绿色算力基础设施助推智算产业可持续发展。

(联想全面打造AI导向的基础设施)

AI算力战略引导下,耿太平分享称,在实际的业务实践中,联想推出了AI算力全栈全域框架,聚焦四大应用场景,提供软硬件的整体方案来推动AI战略不断落地。具体来看,联想不仅提供丰富的AI算力所需的基础设施,还通过整合不同算力需求的AI软件平台,高效覆盖大模型训练、训推一体、AI for Science和AI生成四大应用场景,从而更好地赋能AI行业生态。

耿太平进一步阐述道:“AI大模型训练服务器和AI训推一体服务器+Lenovo AI Master软件的方案,可以覆盖大模型训练和训推一体场景的应用;科学计算异构服务器+LiCO软件的组合,可以覆盖AI for Science场景的应用;AI生成服务器+NVIDIA OVE软件的组合,可以覆盖AI生成场景的应用。”

截至目前,联想已成为全球第三大AI基础设施和服务器供应商,全面覆盖云端、边缘算力场景,同时满足AI大模型和传统模型的训练、推理需求,并实现AI应用场景的深度覆盖,目前已实现智慧制造、智慧医疗、地质勘探等领域的应用。

澎湃算力,构筑坚实AI基础设施底座

AI通用大模型以燎原之势席卷全球,带动算力需求和参数量呈指数级增长,构建满足其发展的AI算力最为紧迫。

第一大场景是AI大模型训练。会上,耿太平分析称,Open AI最新GPT-4模型算力需求是GPT-3的59倍,模型参数量是GPT-3的10倍以上。为满足大规模数据训练需求,AI算力基础设施需具备纵向高性能扩展和横向灵活扩展能力。联想在今年8月推出的联想问天WA7780 G3 AI大模型训练服务器很好的满足了这一需求,具有澎湃性能巨幅提升、灵活架构按需配比和扩展不同算力等特点。

(联想问天 WA7780 G3 AI大模型训练服务器)

性能方面,该服务器可提供32PFLOPS的AI算力,支持高达400Gb/s的高性能网络,拥有高达640GB的HBM3高速显存。由于搭载的H800GPU相较上一代的GPU AI性能有高达3.44倍的提升,同时升级了第4代Tensor Core和 Transformer的引擎,使得大模型AI训练提升9倍,大模型AI推理性能提升30倍。灵活架构方面,该服务器通过采用了GPU Direct Storage (GDS) 技术,让GPU与NVMe直接进行数据的通讯,同时实现GPU与NVMe 灵活配比(1:1或2:1),大幅提高程序载入数据的速度,提升大模型训练的性能。

第二大场景是训推一体场景。为应对大模型推理和传统训练以及云游戏、模拟仿真等多元算力需求,联想问天WA5480 G3 AI 训推一体服务器可支持业界主流的PCle规格的AI加速卡,可以按照场景要求模块化配置GPU算力。该服务器还支持丰富生态,通过对系统拓扑和结构的兼容性设计以及软件的调优,可支持Intel、寒武纪、摩尔等多元AI芯片。此外,该服务器安全可靠,通过N+N冗余的电源设计和动态的软件监控,可确保无间断运行和稳定的性能。

可以看出,联想问天WA7780 G3 AI大模型训练服务器和WA5480 G3 AI 训推一体服务器专为AI大模型而生,满足AI大模型所需的数据训练和推理需求。耿太平还表示,两款服务器在保证高性能的同时实现了低功耗运行。其中,联想问天WA7780 G3 AI大模型训练服务器通过创新三层独立风道设计,根据不同的部件,散热特征进行优化,可以节省散热功耗1000瓦。

绿色算力,加速AI技术高效利用

除了AI大模型蓬勃发展, AI技术与产业融合带动AI应用不断落地掀起产业智能化变革。联想不仅聚焦通用人工智能领域,还看重AI与产业深度融合,致力于为行业智能化变革打造算力“新基建”。

第三大场景是AI for Science,科学计算和AI在加速融合。一方面AI算法科学应用实现了创新发展。如在气象领域,ForecastNet模型可将气象预测的速度提升4.5万倍。在生命科学领域,Alpha Fold2可以帮助科学家精准预测蛋白质的结构。另一方面,针对计算密集型应用,原来在CPU上的科学算法在不断向异构计算进行迁移,如材料科学领域的VASP和冷冻电镜RELION,因此当前科学计算算力基础设施既需要满足传统的科学计算,又需要兼顾日益增长的AI需求。

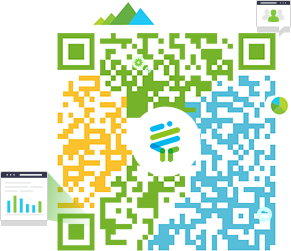

基于此,联想推出了科学异构计算服务器――联想Think System SD650-I V3。这款服务器可实现异构多元,CPU和GPU的比例是1:2,可以进行最佳的异构计算。此外,GPU的双精度算力单节点额可达到210TFLOPS,GPU之间可通过XeLink进行高速互联。该服务器还具有极致高密和绿色节能的特点:42U整机柜可以支持多达144颗GPU,提供7.5PFLOPS的双精度算力; PUE小于1.1, 全水冷设计,零噪音,可支持余热回收。

(联想Think System SD650-I V3)

最后一个是AI生成场景,即 AI生成技术与各行各业深度结合,在未来数字工厂、数字孪生地球、火势蔓延模拟、5G信号模拟等虚拟应用场景加速落地,不断刷新AI创新行业的想象力。而这些应用背后都需要强大的AI算力支持,逼真且低延迟的渲染能力、整合离散的设计工具和协同多人在线实时工作能力等。

联想在这些领域进行了领先布局,推出了AI生成OVX基础设施方案。该方案包含高速全闪存储(DSS-G)用于存放海量的数据、国内首款OVX3.0认证的AI生成服务器,OVX SR675 V3,搭载英伟达 Omniverse Enterprise软件一起来提供AI+渲染能力,同时可实现多种软件工具和多人多地的在线实时协作,还包含高速的交换机,为纵向和横向的扩展部署提供便利。

(联想AI生成OVX基础设施方案)

耿太平表示,在AI浪潮下,AI正加速与产业融合推动智能生产力重塑产业。联想将以AI赋智、绿色赋能全面打造AI导向算力基础设施建设,为助力AI赋能行业提供源源不断的发展动能。

- 上一篇:希尔顿欢朋酒店如何通过老酒店换“新颜”实现蜕变?

- 下一篇:没有了

热门文章

特斯拉大裁员殃及上海厂,电动车该泼冷水了

2024/4/16 14:37:02Steam 3月软硬件调查出炉:简体中文保持第一,RTX 3060继续提升

2024/4/2 16:50:299亿用户、估值300亿美元,「暗黑版微信」Telegram决定上市

2024/4/7 16:53:37木头姐凯茜 ・ 伍德宣布投资OpenAl

2024/4/12 14:32:45艾瑞数据 | 中国共享充电宝行业市场规模

2024/4/19 10:57:49到底什么人在闲鱼上赚到钱了?

2024/4/7 18:21:49

扫一扫,或长按识别二维码

关注艾瑞网官方微信公众号